Questa invece è proprio strana, come mai nel 3D Mark Port Royal il DLSS restituisce un livello di dettaglio incredibile dell'immagine? Cos'è funziona sì/no in base a criteri che non si sono ancora capiti?

Le nuove GPU/CPU/Monitor Stay Tuned :asd: | ( ◡)| Schiavi del Giacchetta (❍ᴥ❍ʋ)Usate la zona tecnica per dubbi/consigli su upgrade!

#13802

Inviato 14 February 2019 - 10:19 PM

Inviato 14 February 2019 - 10:19 PM

Questa invece è proprio strana, come mai nel 3D Mark Port Royal il DLSS restituisce un livello di dettaglio incredibile dell'immagine? Cos'è funziona sì/no in base a criteri che non si sono ancora capiti?

quel coso non è che abbia queste texture ultra definite, è un video pieno di giochi di luce e gradienti, e su quelle cose il DLSS è buono, come FXAA ![]()

#13805

Inviato 15 February 2019 - 03:41 AM

Inviato 15 February 2019 - 03:41 AM

L'idea che c'è dietro, per come l'hanno spiegata loro, funziona non bene, alla stragrande. Solo che hanno commesso un mastodontico errore di nomenclatura... Su Deap Learning posso concordare, alla fine sfrutta l'IA, ma su Super Sampling proprio no. Il DLSS è l'esatto opposto del super sampling.

Praticamente lavora con un'immagine 1440p per farti poi vedere un'immagine in 4K utilizzando i vari algoritmi per renderla il più fedele possibile all'originale ma senza il peso computazionale che renderizzare a tale risoluzione comporterebbe. In pratica si chiama Upscale sotto steroidi ![]() ma mi rendo conto che chiamarlo "upscale" avrebbe fatto storcere il naso a tutti, nonostante alla fin fine sia esattamente questo che fa. Ecco perché reputo i risultati incredibili.

ma mi rendo conto che chiamarlo "upscale" avrebbe fatto storcere il naso a tutti, nonostante alla fin fine sia esattamente questo che fa. Ecco perché reputo i risultati incredibili.

Se c'è una cosa che Quantum Break ci ha insegnato è che upscalare un'immagine del 50% (o comunque giocare con una renderizzazione inferiore alla risoluzione del monitor) fa venire fuori qualcosa di più che osceno, mentre il DLSS risulta infinitamente superiore in tutto ciò. Certo, messe immagine 4K e DLSS con 4K come risoluzione finale una di fianco all'altra è logico che sia la differenza possa essere piuttosto marcata visto che deve "inventarsi quello che non esiste", così come è naturale che su alcuni giochi possa risultare più simile rispetto ad altri: dal momento che inventa, avere numerosi cambi cromatici in un range di pochi pixel (pensiamo ai contorni) obbliga ad applicare un certo livello di aa che a sua volta applica un livello di blur più o meno marcato. Con la speranza che tale li livello sia regolabile dagli sviluppatori, così da fare i test sui propri giochi e poterlo sistemare a dovere invece che "sì, buttiamoci quell'algoritmo così possiamo dire che il nostro gioco lo supporta", direi che ha un incredibile potenziale. Tutto sta a loro riuscire a trovare il giusto compromesso per poterlo sfruttare al meglio ![]()

#13806

Inviato 15 February 2019 - 03:42 AM

Inviato 15 February 2019 - 03:42 AM

#13807

Inviato 15 February 2019 - 09:22 AM

Inviato 15 February 2019 - 09:22 AM

L'idea che c'è dietro, per come l'hanno spiegata loro, funziona non bene, alla stragrande. Solo che hanno commesso un mastodontico errore di nomenclatura... Su Deap Learning posso concordare, alla fine sfrutta l'IA, ma su Super Sampling proprio no. Il DLSS è l'esatto opposto del super sampling.

Praticamente lavora con un'immagine 1440p per farti poi vedere un'immagine in 4K utilizzando i vari algoritmi per renderla il più fedele possibile all'originale ma senza il peso computazionale che renderizzare a tale risoluzione comporterebbe. In pratica si chiama Upscale sotto steroidima mi rendo conto che chiamarlo "upscale" avrebbe fatto storcere il naso a tutti, nonostante alla fin fine sia esattamente questo che fa. Ecco perché reputo i risultati incredibili.

Se c'è una cosa che Quantum Break ci ha insegnato è che upscalare un'immagine del 50% (o comunque giocare con una renderizzazione inferiore alla risoluzione del monitor) fa venire fuori qualcosa di più che osceno, mentre il DLSS risulta infinitamente superiore in tutto ciò. Certo, messe immagine 4K e DLSS con 4K come risoluzione finale una di fianco all'altra è logico che sia la differenza possa essere piuttosto marcata visto che deve "inventarsi quello che non esiste", così come è naturale che su alcuni giochi possa risultare più simile rispetto ad altri: dal momento che inventa, avere numerosi cambi cromatici in un range di pochi pixel (pensiamo ai contorni) obbliga ad applicare un certo livello di aa che a sua volta applica un livello di blur più o meno marcato. Con la speranza che tale li livello sia regolabile dagli sviluppatori, così da fare i test sui propri giochi e poterlo sistemare a dovere invece che "sì, buttiamoci quell'algoritmo così possiamo dire che il nostro gioco lo supporta", direi che ha un incredibile potenziale. Tutto sta a loro riuscire a trovare il giusto compromesso per poterlo sfruttare al meglio

Da quanto hanno detto in vari articoli (che analizzavano il DLSS inizialmente) la risoluzione più bassa scelta non è imposta da Nvidia ma la decidono gli sviluppatori; molto probabilmente provando e verificando i risultati.

Differenze di risoluzione nativa fra FFXIV e la Demo Epic Infiltrator avevano fatto partire il ragionamento.

#13809

Inviato 15 February 2019 - 09:49 AM

Inviato 15 February 2019 - 09:49 AM

Ma sto DLSS potrà essere usato anche da chi ha una 1080 come me oppure è esclusivo della serie 2000?

Solo le RTX grazie ai tensor core.

Da vedere ora le GTX1660/Ti cosa avranno dell'uarch Turing; le unità ray tracing saranno eliminate ma i tensor core? A breve usciranno e lo sapremo.

È proprio per questo che costano le RTX2000: hanno il doppio delle unità che leggete (questo dipendente dall'architettura nuova) + i tensor core (per l'IA) + RayTracing core (dei tensor core specifici).

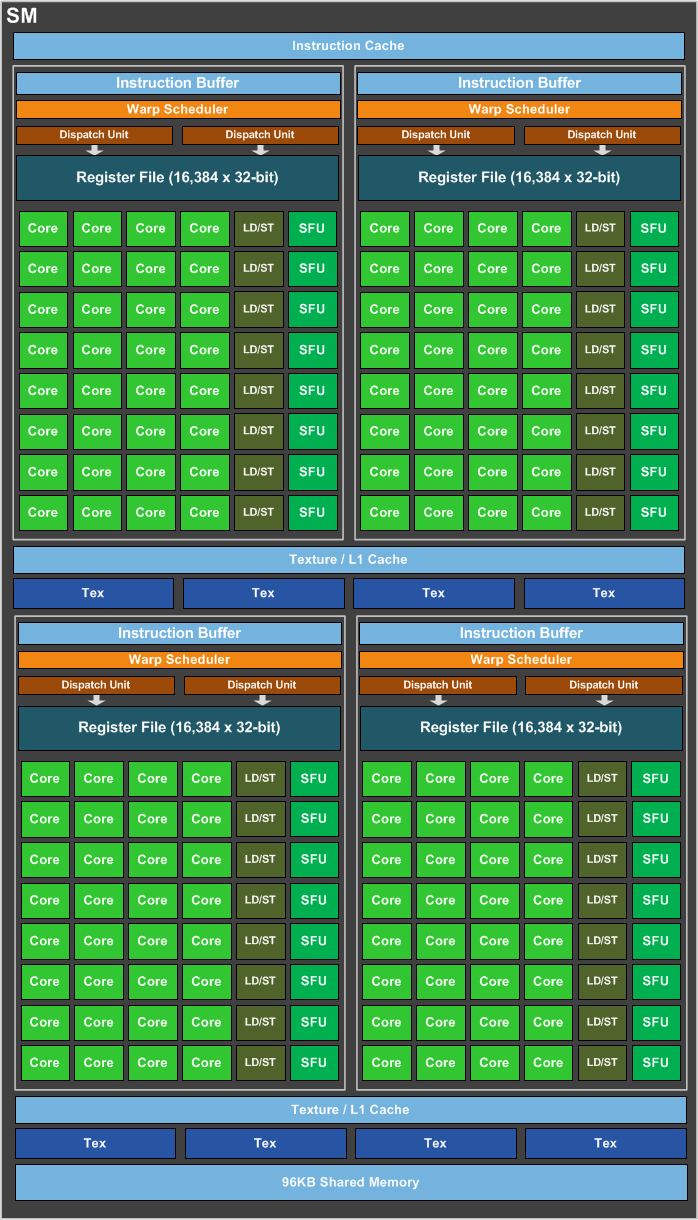

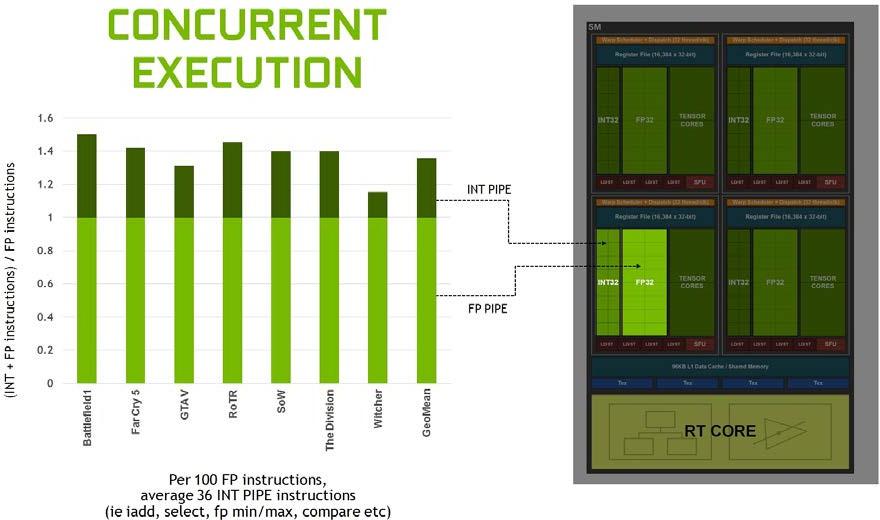

Questa è uno streaming multi-processor Turing (SM) ed è il pezzettino basico di LEGO che compone le GPU 2000. In base a quanti mattoncini metti aumenti gli shaders (unità di calcolo classiche FP32) assieme a tutto il resto.

Invece Pascal è così:

La scritta CORE sono gli FP32 che vedi sopra. Per ogni SM Turing ha 64unità classiche, Pascal invece 128.

Perché i core turing vanno di più per singola unità? Nello specifico perché la GTX1080 con 2560unità va meno di una RTX2070 con 2304?

Perché la nuova architettura ha portato le unità INT32 che aiutano le unità classiche. Quanto? fino al 50% (teorico) ma tantissimo dipende dal gioco, da quanto è aggiornato e dagli stessi sviluppatori.

Ecco perché ste 2000 sono delle padelle (più grande è il chip più diventa costoso da produrre e le rese diventano pessime, con un ricarico sulla parte ben riuscita) costosissime.

Quindi no, il DLSS per come è concepito ora non è possibile sulle Pascal.

Discorso diverso per le AMD in quanto sono adatte a calcoli specifici (in linea teorica sono sempre molto più potenti delle nvidia) e quindi una sorta di DLSS potrebbe essere possibile senza cambiare VEGA; potrebbe ripeto.

#13810

Inviato 15 February 2019 - 10:36 AM

Inviato 15 February 2019 - 10:36 AM

ma tantissimo dipende dal gioco, da quanto è aggiornato e dagli stessi sviluppatori

La cosa puoi estenderla a qualsiasi tipo di calcolo sia necessario: INT32 si occupa dei calcoli con integers, FP32 fa i calcoli in floating point ![]() tutto va in parallelo e in media hai un miglioramento di prestazioni del 25-35%

tutto va in parallelo e in media hai un miglioramento di prestazioni del 25-35%

#13811

Inviato 15 February 2019 - 10:46 AM

Inviato 15 February 2019 - 10:46 AM

La cosa puoi estenderla a qualsiasi tipo di calcolo sia necessario: INT32 si occupa dei calcoli con integers, FP32 fa i calcoli in floating point

tutto va in parallelo e in media hai un miglioramento di prestazioni del 25-35%

Teoria... però s'è visto in alcuni giochi (più vecchi - non ricordo) non funzionare per niente o quasi l'uarch Turing.

Io mi chiedo ancora come sia possibile che tutto sto popò di roba consumi quanto Pascal (va bene, hanno usato 12nm ottimizzando dimensioni/consumi invece delle prestazioni - il contrario di ryzen2000 by AMD) o poco più

#13813

Inviato 15 February 2019 - 11:36 AM

Inviato 15 February 2019 - 11:36 AM

ma il DLSS costa in termini di fps oppure serve proprio per fartene fare di più? perchè se non ho capito male si parlava di fps aumentati durante l'uso del RT proprio grazie al DLSS...

ti abbassa la risoluzione di rendering quindi il framerate aumenta

#13814

Inviato 15 February 2019 - 01:06 PM

Inviato 15 February 2019 - 01:06 PM

Infatti si ottengono ottime performance utilizzandolo con RTX attivo

Ma potrebbe essere anche di grosso aiuto per chi utilizza pannelli 4k e non vuole o non puo spendere per una 2080ti

Ho visto questo video

Certo si concentra di piu su quanti fps genera una 2060 e una 2080 con i due giochi che supportano tali tecnologie

E non fa troppo cenni sui dettagli grafici

Però dico io

Siamo solo agli inizi e si vedono gia buoni risultati

Specie con la 2060 che sta dando da subito grosse soddisfazioni

Attualmente chi vuole spendere tipo 400 Euro, la 2060 mi sembra il top

Anche se io consiglierei di più una 2080 che tra 6 mesi riuscirà a gestire meglio queste tecnologie con l ottimizzazione dei giochi

#13815

Inviato 15 February 2019 - 02:15 PM

Inviato 15 February 2019 - 02:15 PM

Per me il DLSS allo stato attuale aiuta (non poco) chi vuole utilizzare l RTX

Infatti si ottengono ottime performance utilizzandolo con RTX attivo

Ma potrebbe essere anche di grosso aiuto per chi utilizza pannelli 4k e non vuole o non puo spendere per una 2080ti

Ho visto questo video

Certo si concentra di piu su quanti fps genera una 2060 e una 2080 con i due giochi che supportano tali tecnologie

E non fa troppo cenni sui dettagli grafici

Però dico io

Siamo solo agli inizi e si vedono gia buoni risultati

Specie con la 2060 che sta dando da subito grosse soddisfazioni

Attualmente chi vuole spendere tipo 400 Euro, la 2060 mi sembra il top

Anche se io consiglierei di più una 2080 che tra 6 mesi riuscirà a gestire meglio queste tecnologie con l ottimizzazione dei giochi

Secondo me il problema è la scarsa ottimizzazione dei giochi anche per una 2060 ... Per esempio a me che importa solo giocare a ultra in 1080p 60 fps con dlss e ray tracing, mi devo per forza comprare una 2080. Mi sembra un pò esagerato, in questa momento è davvero un limbo la situazione delle schede video. Tutte buone, ma nessuna che eccelle davvero. 4K Compreso la 2080 già fatica. Però ripeto, secondo me è la scarsa ottimizzazione dei giochi.

Leggono questa discussione 5 utenti

0 utenti, 5 ospiti, 0 utenti anonimi

Connettiti

Connettiti Registrati subito

Registrati subito

Torna su

Torna su